Das Zeitalter der neuronalen Netze

In diesem Kapitel gebe ich einen Überblick von den ersten Anfängen der computerbasierten neuronalen Netze über die unterschiedlichen Netzwerktypen und ihre jeweilige Bedeutung in verschiedenen Feldern der Künstlichen Intelligenz bis hin zu den Transformernetzwerken und den daraus resultierenden großen Sprachmodellen.

Wenn wir im Folgenden von neuronalen Netzen reden, sind damit immer künstliche, computerbasierte neuronale Netzwerke gemeint, wenn nicht ausdrücklich etwas anderes erwähnt ist.

Was ist überhaupt ein Neuron?

Etwas vereinfacht kann man sagen, dass die Gehirne von Menschen und Tieren Informationen verarbeiten, die wir über unsere Sinnesorgane erhalten, diese mit Wissen verknüpfen, das wir erlernt oder durch Erfahrung gewonnen haben, und daraufhin Output in Form von Anweisungen an Muskeln, Organe, Drüsen usw. erzeugen.

Die Verarbeitung findet auf der biologischen Hardware des Gehirns auf elektrochemischem Wege statt. Schaut man sich ein Gehirn unter dem Mikroskop etwas genauer an, so kann man einzelne Zellen erkennen, die untereinander vielfach verknüpft sind. Diese Zellen bezeichnen wir als Neuronen.

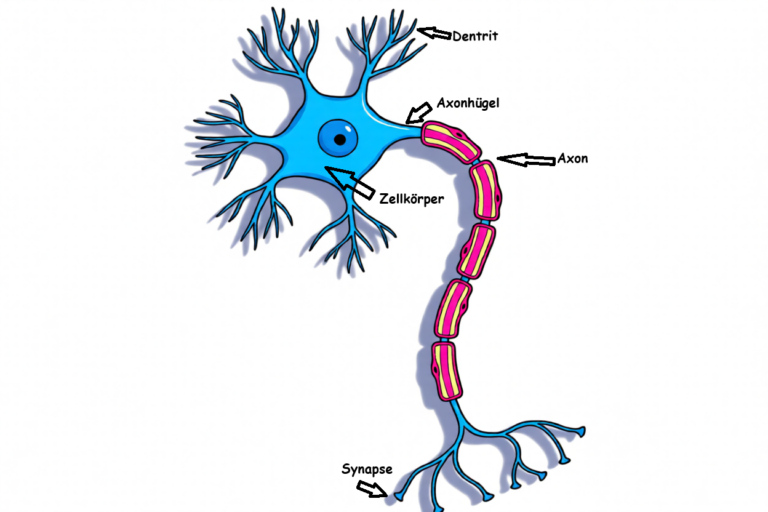

Wiederum etwas vereinfacht besteht ein Neuron aus folgenden Bestandteilen:

Dendriten: Verzweigte „Eingänge“, an denen Signale von vielen anderen Nervenzellen über Synapsen ankommen.

Zellkörper (Soma): Enthält den Zellkern; dort werden die über die Dendriten einkommenden Signale verrechnet.

Axonhügel: Stelle, an der entschieden wird, ob ein Aktionspotenzial ausgelöst wird.

Axon: Langer Fortsatz, über den elektrische Signale weitergeleitet werden.

Synapsen: Kontaktstellen am Axonende, an denen das Signal chemisch auf die nächste Zelle übertragen wird.

Schon in den frühen 1940er‑Jahren begannen Arbeiten daran, die grundlegenden Eigenschaften solcher Neuronen mathematisch zu erfassen und auf künstlicher Hardware nachzubauen.

Die McCulloch‑Pitts‑Neuronen

Der Logiker Walter Harry Pitts Jr. (1923–1969) und der Neurophysiologe und Kybernetiker Warren Sturgis McCulloch (1898–1969) veröffentlichten 1943 ihr wegweisendes Papier „A Logical Calculus of the Ideas Immanent in Nervous Activity“ (~ „Ein logisches Kalkül für die Prinzipien des Nervensystems“).

In dieser Arbeit beschrieben die beiden ein Netz aus idealisierten Nervenzellen und zeigten, dass Netzwerke solcher Einheiten jedes algorithmisch lösbare Problem bearbeiten können. Das bedeutet grob gesagt: Wenn es eine Handlungsanweisung (einen Algorithmus) zur Lösung eines Problems gibt, dann kann ein solches Netzwerk diese Berechnung ebenfalls ausführen.

Für die informatik affinen Leser: Das heißt, dass solche Netze theoretisch jede Turing‑berechenbare Funktion darstellen können.

McCulloch (rechts) and Pitts (links) im Jahr 1949. Originalbild von www.semanticscholar.org. Video generiert mit Seedance KI Video Generator.

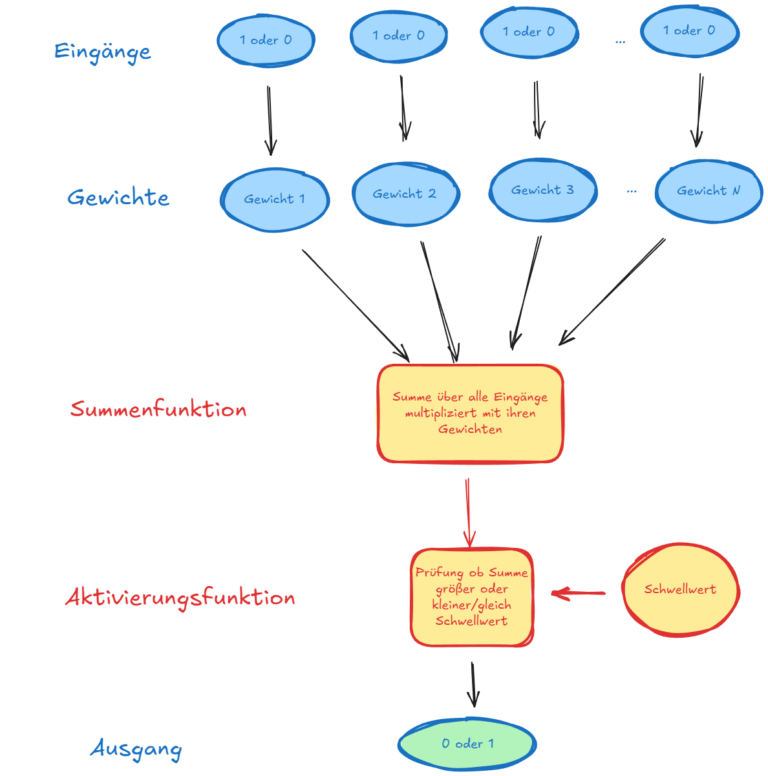

Analog zu biologischen Neuronen können McCulloch‑Pitts‑Neuronen mehrere Eingangswerte erhalten. Im Unterschied zu den über die Dendriten ihrer biologischen Vorbilder transportierten Informationen werden hier allerdings nur binäre Werte (0 oder 1) verarbeitet. Jeder Eingang hat zudem ein sogenanntes Gewicht, das steuert, wie viel Einfluss dieser Eingang auf das Ergebnis der späteren Berechnung hat.

Diese Gewichte kann man sich – grob vereinfacht – ähnlich wie im biologischen Modell so vorstellen, dass nicht jeder Eingang gleich „wichtig“ ist. Ein Eingangssignal, das etwa aus einer im Augenwinkel wahrgenommenen Bewegung resultiert, hat unter Umständen ein höheres Gewicht als ein Eingangssignal, das von der Wahrnehmung eines Regentropfens stammt. Wir können uns diese Gewichte als Kennzahl für durch Vererbung oder Erfahrung erlerntes Wissen vorstellen.

In der Originalarbeit von McCulloch und Pitts wurden dafür meist ganzzahlige Gewichte (auch negative, als Hemmung) verwendet. Aus den mit den Gewichten kombinierten Eingangswerten wird eine Summe gebildet. Liegt diese Summe über einem festgelegten Schwellwert, so wird am Ausgang eine 1 geliefert, ansonsten eine 0.

In der Abbildung sehen wir, wie in einem McCulloch-Pitt Neuron die binären Eingangssignale gewichtet einlaufen.

In der Summenfunktion werden die gewichteten Einganswerte summiert. Anschließen entscheidet die Aktivierungsfunktion ob der ermittelte Wert oberhalb oder unterhalb des Schwellwertes liegt und liefert entsprechend das binäre Ergebnis.

Die folgende Tabelle zeigt, wie sich die unterschiedlichen Aspekte des biologischen Neurons zum McCulloch‑Pitts‑Neuron verhalten.

| Biologisches Neuron | McCulloch-Pitts-Neuron |

|---|---|

| Dendriten (erhalten Spannungsänderungen) | Eingänge (jeder Eingang ist entweder 0 oder 1) |

| Zellkörper (räumliche und zeitliche Aufsummierung) | Summenfunktion (Summe über alle mit jeweiligem Gewicht multiplizierten Eingangswerten) |

| Axonhügel (entscheidet, ob ein Aktionspotenzial ausgelöst wird) | Schwellwertfunktion (entscheidet, ob Summe größer oder kleiner/gleich Schwellwert ist) |

| Synapsen (Kontaktstellen zu anderen Neuronen) | Ausgang (0 oder 1) |

Netzwerke aus McCulloch‑Pitts‑Neuronen waren zu diesem Zeitpunkt noch ein rein theoretisches, stark idealisiertes Modell mit binären Eingaben/Ausgaben und festen, nicht lernenden Gewichten. Im nächsten Kapitel erfahren wir, wie diese Idee dann zum Perceptron weiterentwickelt und dann auch in lauffähiger Hard und Software umgesetzt wurde.